LLM (Large Language Model) : définition, fonctionnement et applications

22 min de lecture

Mis à jour le

Les Large Language Models (LLMs) sont au cœur de la révolution IA actuelle. Propulsés par les avancées en deep learning, ces modèles comme GPT-5.4, Claude Opus 4.6, Gemini 3.1 Pro, Grok 4 ou Llama 4 sont capables de comprendre, générer et traduire du texte avec une aisance bluffante. Leur montée en puissance, notamment depuis la sortie de ChatGPT fin 2022, a marqué un tournant décisif dans l’adoption massive de l’IA. En 2025-2026, la compétition entre les grands laboratoires s’est intensifiée, avec l’émergence de modèles de raisonnement, de modèles unifiés comme Mistral Small 4, et d’acteurs comme DeepSeek et xAI qui redistribuent les cartes.

Mais concrètement, c’est quoi un LLM ? Comment ça fonctionne, et quelles sont leurs limites ? Pour bien comprendre, un petit détour par les fondamentaux du deep learning peut être utile. On vous explique tout, simplement.

Définition des Large Language Models (LLM)

Qu’est-ce qu’un Large Language Model ?

Un Large Language Model (LLM), ou grand modèle de langage en français, est un modèle d’intelligence artificielle entraîné sur d’immenses corpus de texte pour comprendre et générer du langage naturel. Basé sur une architecture de type transformeur, il apprend les structures du langage en prédisant le mot suivant dans une séquence, ce qui lui permet de traduire, résumer, classer ou rédiger du texte de manière cohérente.

Ils sont dits “grands” ou “larges” en raison du volume considérable de données utilisées pour leur entraînement. Les LLM sont souvent basés sur des architectures dites de “transformateurs” et sont formés sur des ensembles de données textuelles immenses, allant de la littérature aux contenus en ligne, en passant par l’actualité et les réseaux sociaux.

En raison de leur taille et de leur complexité, les LLM peuvent accomplir une variété de tâches liées au langage naturel, allant de la génération et la classification de texte, à la réponse à des questions de manière conversationnelle et la traduction de texte d’une langue à une autre. Parmi les LLMs les plus populaires on retrouve :

-

GPT-5.4 (Generative Pre-trained Transformer) : Développé par OpenAI, GPT-5.4 (sorti le 5 mars 2026) est le dernier flagship de la série GPT, avec une fenêtre de contexte d’1 million de tokens, des niveaux de raisonnement configurables et l’utilisation native d’un ordinateur (computer use). Il affiche 33 % d’erreurs factuelles en moins par rapport à GPT-5.2. Décliné en versions GPT-5.4 mini et GPT-5.4 nano (sorties le 17 mars), il alimente ChatGPT et Copilot de Microsoft. OpenAI propose également des modèles de raisonnement comme o3 et o4-mini, capables d’utiliser tous les outils de ChatGPT de manière agentique.

-

Mistral Small 4 : Développé par Mistral AI, la start-up française devenue une référence mondiale. Mistral Small 4 (sorti le 16 mars 2026) est le premier modèle Mistral à unifier raisonnement (Magistral), vision multimodale (Pixtral) et code agentique (Devstral) dans un seul modèle. Avec 119 milliards de paramètres au total et seulement 6,5 milliards actifs grâce à son architecture Mixture-of-Experts, il offre 40 % de latence en moins et un débit triplé par rapport à Mistral Small 3. Mistral AI propose également Mistral Large 3 (675 milliards de paramètres) pour les tâches les plus exigeantes. La majorité de ces modèles sont open source sous licence Apache 2.0, un argument clé pour les clients qui souhaiteraient héberger le modèle chez eux.

-

Llama 4 (Large Language Model Meta AI 4) : Développé par Meta, Llama 4 est la quatrième génération de la série. Les modèles Llama 4 Scout et Llama 4 Maverick sont nativement multimodaux et utilisent une architecture Mixture-of-Experts. Llama 4 Scout offre notamment une fenêtre de contexte record de 10 millions de tokens. Très apprécié pour son caractère open source, Llama 4 rivalise avec les meilleurs modèles propriétaires sur de nombreux benchmarks.

-

Claude Opus 4.6 : Développé par Anthropic, Claude est une série de modèles de langage conçus pour la fiabilité et l’alignement sur les valeurs humaines. Claude Opus 4.6 (sorti le 5 février 2026) trône au sommet du classement LM Arena (ELO 1504) et offre une fenêtre de contexte d’un million de tokens. Claude Sonnet 4.6 (17 février 2026) offre des performances proches à un cinquième du coût. Claude se décline en trois tailles (Haiku, Sonnet, Opus) pour s’adapter aux différents besoins de performance et de coût.

-

Gemini 3.1 Pro : Développé par Google DeepMind, Gemini 3.1 Pro (sorti le 19 février 2026) est le modèle le plus intelligent de Google. Il se hisse au 2e rang du classement LM Arena (ELO 1500) et double les performances de raisonnement de Gemini 3 Pro. Disponible en versions Pro, Flash et Deep Think, il se distingue par ses capacités multimodales avancées (texte, image, audio, vidéo).

-

Grok 4 : Développé par xAI (fondé par Elon Musk), Grok 4 est un modèle multimodal conçu pour le raisonnement avancé, le code et la recherche en temps réel via la plateforme X. Avec une fenêtre de contexte de 256 000 tokens (jusqu’à 2 millions en version Fast) et 65 % d’hallucinations en moins que son prédécesseur grâce à la mise à jour Grok 4.1, il s’est rapidement imposé parmi les modèles de pointe.

-

DeepSeek-R1 : Développé par DeepSeek, une entreprise chinoise, ce modèle de raisonnement open source a provoqué une onde de choc dans l’industrie début 2025. Avec des performances comparables à celles d’OpenAI o1 sur les tâches de mathématiques, de code et de raisonnement, le tout publié sous licence MIT, DeepSeek a démontré qu’il était possible d’atteindre des performances de pointe avec des ressources plus limitées. DeepSeek prépare également V4, un modèle d’environ 1 000 milliards de paramètres avec une fenêtre d’un million de tokens et des capacités multimodales natives, dont une préversion (V4 Lite) est apparue en mars 2026.

💡 Pour aller plus loin : Consultez notre comparatif LLM 2026 pour choisir le bon modèle selon votre cas d’usage, ou estimez le coût de votre intégration avec notre simulateur de coûts IA.

Terminologie et concepts clés pour briller en société

Le monde de la technologie et du digital n’est pas avare en jargon. Mais le monde de l’IA est probablement le champion incontesté en la matière alors voici un récapitulatif des termes les plus importants à comprendre quand on parle de LLM.

C’est parti :

-

Modèle de langage : Un type de modèle d’intelligence artificielle conçu pour comprendre et générer du texte en langage naturel.

-

Entraînement : La phase où le modèle est formé sur de vastes ensembles de données générales pour apprendre les structures linguistiques de base.

-

Zero-shot Learning : La capacité d’un modèle à effectuer une tâche pour laquelle il n’a pas été spécifiquement entraîné, en utilisant ses connaissances générales.

-

Prompt : Le texte d’entrée fourni à un modèle de langage pour obtenir une réponse. La formulation du prompt peut fortement influencer la qualité de la réponse générée.

-

Paramètre : Une valeur ajustable dans un modèle de langage qui est modifiée durant l’entraînement pour améliorer les performances du modèle. Les LLM peuvent avoir des milliards de paramètres.

-

Transformer (transformateur): Une architecture de modèle qui utilise des mécanismes d’attention pour traiter et comprendre le texte. C’est la base des modèles modernes comme GPT-5 ou Claude.

-

Mixture-of-Experts (MoE) : Une architecture où seule une partie des paramètres du modèle est activée pour chaque requête, ce qui permet d’avoir des modèles très performants tout en limitant la puissance de calcul nécessaire. C’est l’approche utilisée par Mistral Small 4, Mistral Large 3 et Llama 4.

-

Computer use (utilisation d’ordinateur) : La capacité d’un modèle à interagir directement avec un bureau d’ordinateur, interpréter des captures d’écran, contrôler la souris et le clavier, et automatiser des tâches. GPT-5.4 est le premier modèle généraliste d’OpenAI à intégrer cette fonctionnalité nativement.

-

Modèle de raisonnement : Un type de LLM entraîné pour “réfléchir” plus longuement avant de répondre, en décomposant les problèmes étape par étape. Les modèles o3 d’OpenAI et DeepSeek-R1 en sont des exemples.

-

Attention : Un mécanisme qui permet au modèle de se concentrer sur les parties les plus importantes du texte pour mieux comprendre le contexte.

-

Token (jeton) : Une unité de texte, comme un mot ou une partie d’un mot, que le modèle analyse et traite pour comprendre et générer des phrases.

-

Masque : Un mécanisme utilisé pour guider le modèle sur quelles parties du texte il doit se concentrer ou ignorer.

-

Fine-tuning : L’ajustement d’un modèle pré-entraîné sur des données spécifiques à une tâche particulière pour améliorer ses performances sur cette tâche.

Avec ça vous serez incollables, ou presque !

Applications et utilisations des LLM

Les applications des LLM sont très nombreuses, touchant tous les secteurs et provoquant une véritable révolution dans la plupart d’entre eux. Les LLMs sont utilisés massivement dans le marketing, le développement web, les services clients, la création audiovisuelle, et bien d’autres domaines. Plus concrètement, voici quelques applications fréquentes des LLMs :

-

Les assistants virtuels : Les LLMs sont utilisés pour développer des assistants virtuels capables de répondre à des questions, fournir des informations et assister les utilisateurs dans diverses tâches. Dans le cas de l’utilisation par les entreprises, l’utilisation d’un RAG peut en plus entraîner un assistant virtuel spécifiquement sur les données internes.

-

Chatbots : Ils alimentent des chatbots avancés qui peuvent engager des conversations naturelles avec les utilisateurs, aidant ainsi au service client et à l’engagement utilisateur.

-

Outils de rédaction : Les LLMs aident à la rédaction automatique de textes, que ce soit pour des e-mails, des articles, des rapports ou des récits créatifs, en prolongeant les idées et en apportant de la cohérence au texte.

-

Traduction automatique : En comprenant le contexte des phrases, les LLMs peuvent traduire du texte d’une langue à une autre tout en conservant le sens et le style original. Certains outils utilisent les capacités des LLMs pour traduire des vidéos, allant jusqu’à modifier l’image pour assurer une synchronisation labiale pour chaque langue.

-

Réponse à des questions : Ils sont capables de répondre à des questions en utilisant les informations qu’ils ont apprises, fournissant ainsi des réponses précises et informées.

-

Classification des documents ou informations : Une application technique des LLMs est la classification automatique des documents ou des informations. Cette tâche se fait souvent en arrière-plan sur un serveur ou via une API et est extrêmement utile pour tagger des demandes utilisateurs, leur associer une criticité, etc.

-

Parsing de sites web : Le parsing de sites web est grandement facilité par les LLMs, car l’IA “comprend” le contenu du site, y compris à partir d’images. C’est une véritable révolution dans ce domaine.

-

Transformation de données : Les LLMs peuvent transformer des données déconstruites ou dans un certain format (par exemple, un tableau Excel ou une réponse API) vers un nouveau format (comme JSON), facilitant ainsi l’intégration et l’utilisation des données.

Il y a bien d’autres usages aujourd’hui, et de nouveaux sont inventés presque tous les jours. Comprendre les LLMs est donc devenu une compétence clé, car leur utilisation se répandra de plus en plus dans divers domaines.

Fonctionnement des Large Language Models (LLMs)

Principe de Fonctionnement d’un LLM

Le fonctionnement des LLM repose sur une série de principes fondamentaux du Machine Learning et des architectures neuronales. Le premier pas dans ce processus est l’entraînement. Les LLM sont entraînés sur des corpus de texte gigantesques, souvent composés de trillion de mots.

Durant l’apprentissage, les LLM prennent des séquences de texte en entrée et génèrent des prédictions basées sur le contexte. Ils utilisent pour ce faire des masques et des token (jetons). Le modèle est ensuite capable de générer des textes semblables à ceux qu’il a appris, en capturant le contexte, le ton, les nuances et même les éléments culturels du langage.

C’est cette capacité à identifier le sens d’une phrase (et non pas “comprendre”) et générer des textes cohérents à sa suite qui rend les LLMs si efficaces pour des tâches aussi variées que la rédaction de textes, la traduction en plusieurs langues ou encore la conduite de conversations.

C’est donc finalement, et dit très grossièrement, une question de probabilité. Un LLM ne comprend pas vraiment ce que vous lui dites, ni ce qu’il vous répond, mais il peut très probablement fournir la réponse que vous recherchez.

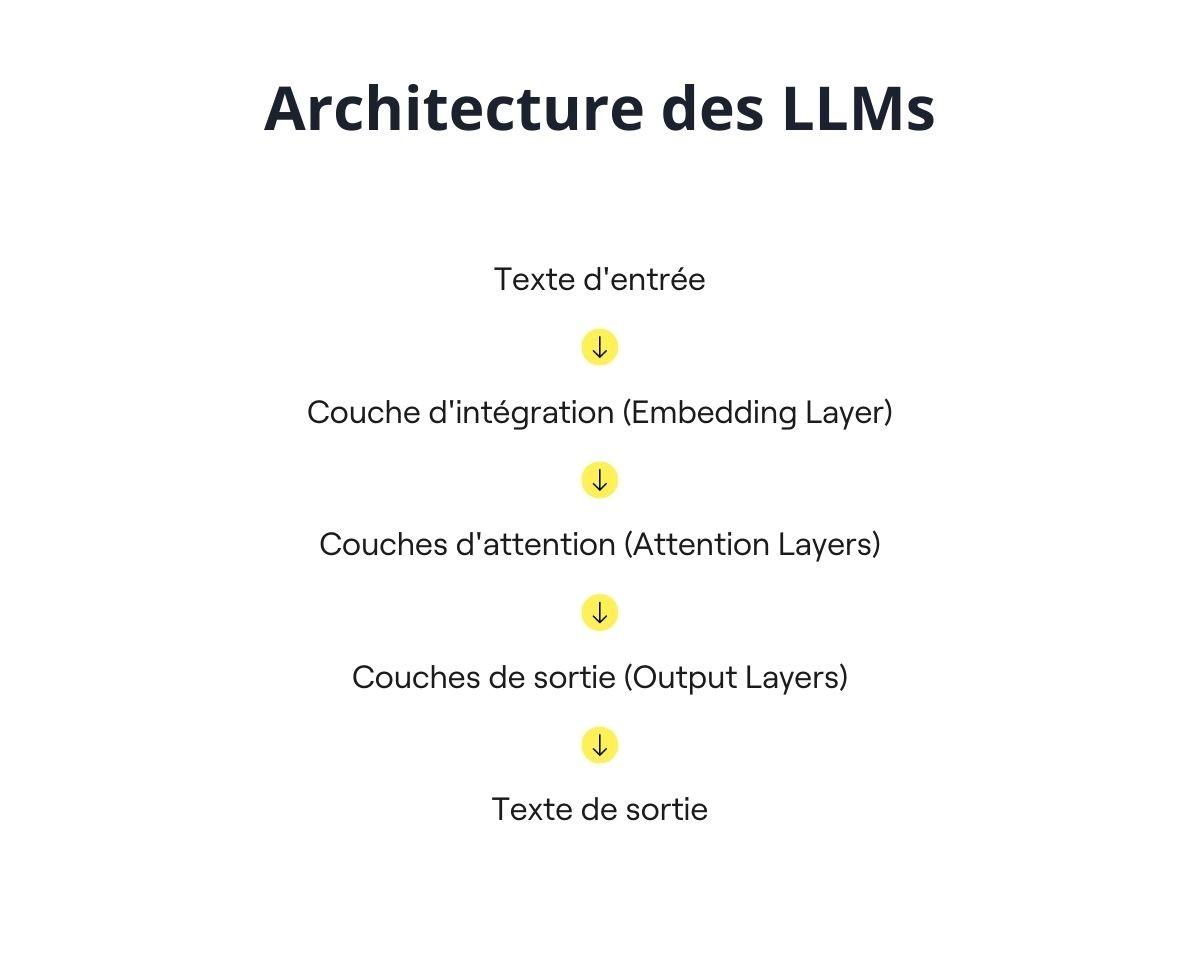

L’architecture des LLMs

Quand on parle d’architecture, on parle des principes techniques qui permettent aux LLMs de fonctionner.

L’architecture des LLMs est généralement basée sur des modèles de transformateurs, qui sont des réseaux de neurones profonds. Certains modèles récents adoptent une architecture Mixture-of-Experts (MoE), où seule une fraction des paramètres est activée pour chaque requête, permettant d’allier performance et efficacité. Ils comprennent plusieurs éléments clefs dont :

-

Les couches d’intégration (embeddings) : Ces couches transforment les mots en vecteurs numériques, permettant aux modèles d’analyser les données textuelles.

-

Les couches d’attention : Elles permettent au modèle de se concentrer sur les parties pertinentes d’un texte lors de la génération de réponses.

-

Les couches de sortie (output layers) : Elles génèrent les prédictions finales du modèle.

Les LLMs possèdent un grand nombre de paramètres, qui sont des valeurs ajustables dans le modèle. Ces paramètres sont modifiés durant l’entraînement pour améliorer les performances du modèle. L’architecture des LLMs peut varier en taille, avec des modèles allant de quelques millions à des centaines de milliards de paramètres. Plus le nombre de paramètres est élevé, plus le modèle est capable de réaliser des tâches complexes et de produire des réponses précises et pertinentes.

Cette précision a un coût, puisque le nombre de paramètres et la taille du modèle ont un impact sur la puissance de calcul nécessaire pour faire fonctionner ce modèle. De plus, le nombre de paramètres influence également le processus de fine-tuning. Le fine-tuning consiste à ajuster un modèle pré-entraîné sur un ensemble de données spécifique pour une tâche particulière, et un modèle avec un grand nombre de paramètres peut nécessiter plus de ressources et de temps pour ce processus.

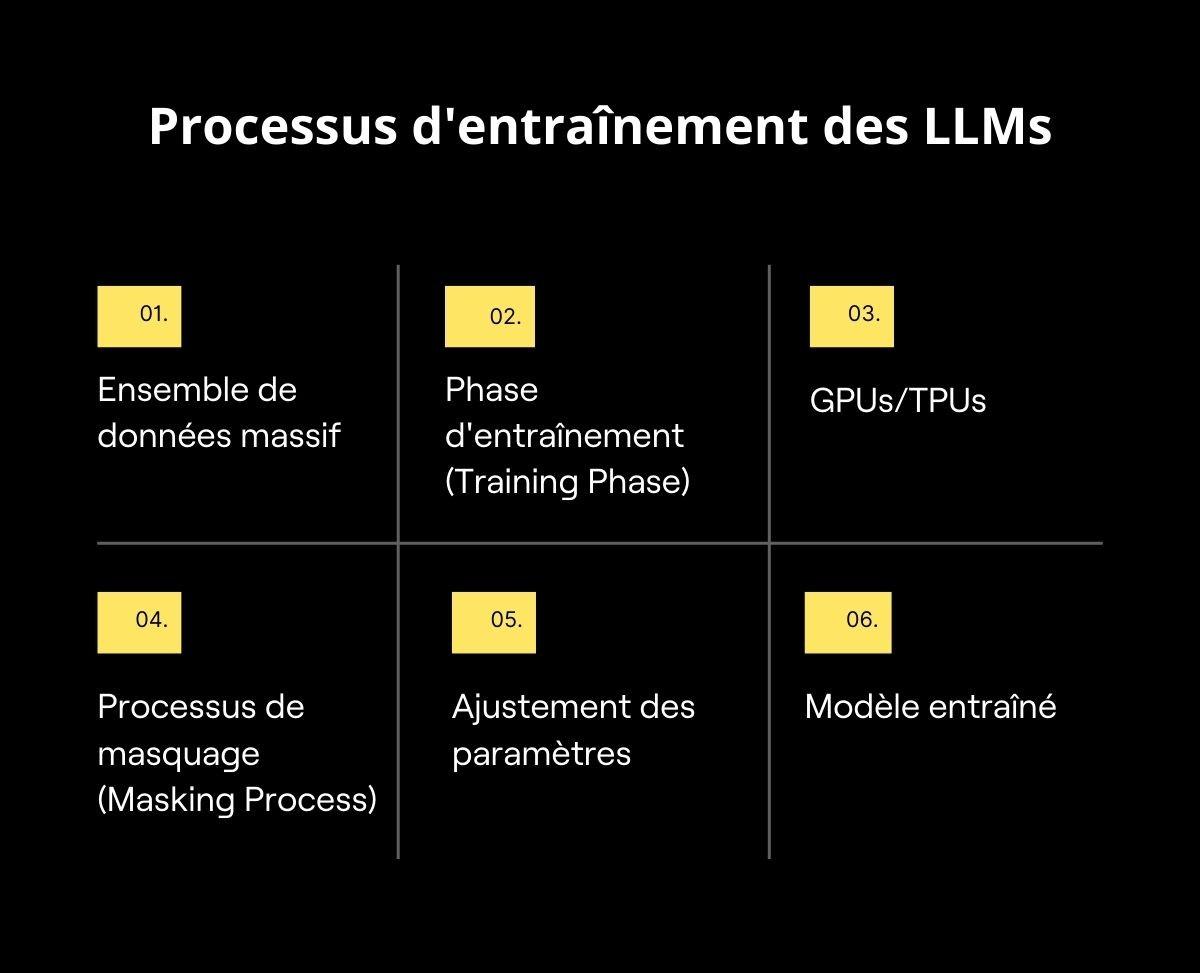

Comment sont-ils entraînés ?

L’entraînement des LLM se fait à travers un processus appelé apprentissage supervisé. Durant cette phase, les modèles sont alimentés par d’immenses ensembles de données textuelles, comprenant des milliers de milliards de mots et de phrases. Ces données servent d’exemples pour le modèle, qui apprend à prédire le mot suivant dans une phrase en se basant sur le contexte fourni par les mots précédents.

Les LLM utilisent une technique spécifique appelée masquage, qui consiste à cacher certains mots dans une phrase et à demander au modèle de les prédire. Cette méthode permet aux LLM de comprendre les relations entre les mots et d’apprendre la structure du langage.

En termes de matériel, l’entraînement des Large Language Models nécessite des ressources informatiques considérables, avec des processeurs graphiques hautement performants. C’est un processus qui peut prendre plusieurs semaines, voire des mois, en fonction de la taille du modèle et de la quantité de données à traiter.

C’est également l’entraînement qui pose de nombreuses questions d’éthique aujourd’hui, les développeurs de LLM étant très évasifs sur la source des données qui ont servi à l’entraînement et dans quelle mesure cela pourrait enfreindre les règles de la propriété intellectuelle.

Performance et évaluation

Bien entendu on ne fait pas une confiance aveugle à l’entraînement des LLMs, pour les affiner et les évaluer on va utiliser des méthodes d’évaluation de leur performance. Ces méthodes vont mesurer plusieurs métriques de performance, notamment :

La perplexité

La perplexité évalue la capacité d’un modèle à prédire une séquence de mots. Plus la perplexité est basse, meilleure est la prédiction du modèle, indiquant une meilleure compréhension du texte.

L’exactitude (Accuracy)

L’exactitude mesure le pourcentage de prédictions correctes effectuées par le modèle. Bien qu’elle soit couramment utilisée pour les tâches de classification, elle s’applique aussi aux tâches de traitement du langage naturel comme la classification de texte.

Le F1-Score

Le F1-score combine deux aspects importants : la précision et le rappel. La précision indique le pourcentage de prédictions correctes parmi celles faites par le modèle, tandis que le rappel montre le pourcentage des éléments corrects qui ont été identifiés par le modèle.

BLEU (Bilingual Evaluation Understudy)

Le score BLEU compare la qualité du texte généré par le modèle à des références humaines. Principalement utilisé pour évaluer les systèmes de traduction automatique, un score BLEU élevé indique une forte similarité avec les traductions humaines.

ROUGE (Recall-Oriented Understudy for Gisting Evaluation)

Le score ROUGE mesure la qualité des résumés automatiques en comparant les chevauchements de n-grammes avec des résumés de référence. En d’autres termes, ROUGE évalue dans quelle mesure le résumé généré par le modèle correspond aux résumés créés par des humains. Un score ROUGE élevé indique que le modèle a bien capturé les points clés et l’essence du texte source.

Défis et perspectives des Large Language Models

Limites actuelles des LLM

Bien que très impressionnants, les LLMs conservent des limites significatives en 2026.

Sur le plan éthique, les LLM peuvent reproduire et amplifier les biais présents dans les données d’entraînement, conduisant à des résultats discriminatoires. Les efforts des laboratoires pour réduire ces biais progressent, mais le problème reste structurel tant que les données d’entraînement reflètent les biais existants dans la société.

L’impact environnemental est devenu une préoccupation majeure. La consommation électrique des centres de données devrait approcher 1 050 térawattheures en 2026, soit l’équivalent de la consommation du Japon. L’empreinte carbone des systèmes d’IA pourrait représenter entre 30 et 80 millions de tonnes de CO2 par an. Cette réalité pousse l’industrie à investir dans des modèles plus efficaces et des sources d’énergie renouvelables.

Les LLM font également face à des problèmes de scalabilité et de coûts. À mesure que les modèles deviennent plus grands, les besoins en calcul et en mémoire augmentent, rendant difficile l’entraînement et le déploiement de modèles extrêmement volumineux. Toutefois, l’émergence d’architectures Mixture-of-Experts et de techniques d’optimisation comme celles de DeepSeek montre qu’il est possible d’atteindre des performances de pointe avec des ressources plus contenues. Pour estimer concrètement le coût d’utilisation d’un LLM dans votre produit, le simulateur de coûts IA compare les principaux modèles en fonction de votre volume.

Un autre exemple de limitation se manifeste dans la génération de textes trop génériques pour être utilisables efficacement par les professionnels. Les LLM ont tendance à produire des réponses qui manquent de spécificité et de précision contextuelle. Des techniques avancées comme le Retrieval-Augmented Generation (RAG) permettent de surmonter cette limite et de produire des réponses bien plus pertinentes dans un contexte donné.

Les LLMs absorbent également du contenu protégé ou sans autorisation, ce qui pose des problèmes de droits d’auteur. Douze affaires majeures ont été regroupées devant le tribunal fédéral de New York en avril 2025, incluant des actions du New York Times, du Chicago Tribune et de nombreux auteurs. En janvier 2026, un juge a confirmé l’obligation pour OpenAI de produire 20 millions de conversations ChatGPT anonymisées comme preuves. De nouvelles poursuites continuent d’émerger, comme celle d’Encyclopaedia Britannica et Merriam-Webster en mars 2026. En parallèle, des accords de licence se multiplient, à l’image du partenariat entre Disney et OpenAI pour la génération de vidéos avec les personnages Disney. Aucune décision de fond sur le “fair use” appliqué à l’entraînement d’IA n’a encore été rendue.

Solutions possibles

Pour surmonter certaines de ces limitations, plusieurs solutions se développent activement :

-

Modèles plus petits et plus spécialisés : Des modèles comme GPT-5.4 nano d’OpenAI, Ministral 3 (3B paramètres) de Mistral ou Llama 4 Scout (17B paramètres actifs) de Meta démontrent qu’il est possible d’obtenir d’excellentes performances avec une architecture optimisée et un nombre réduit de paramètres, réduisant ainsi la consommation de ressources.

-

Modèles unifiés : Plutôt que de proposer des modèles séparés pour le raisonnement, la vision et le code, la tendance est à l’unification. Mistral Small 4 combine ces trois capacités dans un seul modèle avec seulement 6,5 milliards de paramètres actifs, simplifiant le choix et le déploiement pour les développeurs.

-

Architectures Mixture-of-Experts : En activant uniquement une fraction des paramètres pour chaque requête, les modèles MoE comme Mistral Small 4, Mistral Large 3 ou Llama 4 Maverick offrent un excellent rapport performance/efficacité énergétique.

-

Modèles fonctionnant en local : L’utilisation de NPU (Neural Processing Unit) sur les appareils des utilisateurs permet de faire tourner des modèles en local, réduisant ainsi la consommation d’énergie et augmentant la confidentialité des données. Cette tendance s’accélère avec la disponibilité de modèles open source de petite taille performants.

-

Optimisation de l’inférence : Les recherches se concentrent de plus en plus sur l’efficacité au moment de l’exécution (inference-time scaling), avec des techniques comme la distillation de modèles de raisonnement développées au MIT, qui permettent de doubler la vitesse d’entraînement tout en préservant la qualité des résultats.

En résumé, bien que les LLMs soient très puissants et polyvalents, l’industrie continue de développer des solutions pour atténuer leurs limitations et maximiser leurs avantages de manière éthique et durable.

Innovations et améliorations en cours

Les LLMs sont en constante évolution, avec des avancées rapides sur plusieurs fronts simultanément. Les domaines clés de l’innovation en 2025-2026 incluent :

-

Modèles de raisonnement : L’une des avancées les plus marquantes est l’émergence des modèles de raisonnement (reasoning models). Chaque grand laboratoire a publié au moins un modèle de ce type : o3 et o4-mini chez OpenAI, Magistral chez Mistral, DeepSeek-R1. La tendance en 2026 est à l’intégration du raisonnement directement dans les modèles généralistes, avec des niveaux d’effort configurables (comme le “reasoning effort” de GPT-5.4 ou le raisonnement intégré de Mistral Small 4).

-

Inference-time scaling : Plutôt que d’augmenter indéfiniment la taille des modèles à l’entraînement, la recherche se concentre sur l’optimisation du temps de réflexion au moment de l’exécution. L’idée : permettre au modèle de “réfléchir plus longtemps” sur les questions difficiles tout en répondant rapidement aux questions simples.

-

Open source en plein essor : La compétition open source s’est intensifiée avec des acteurs comme Meta (Llama 4), Mistral (Mistral Small 4 sous Apache 2.0, Mistral Large 3) et DeepSeek (R1, V3, V4 en préparation). Ces modèles rivalisent désormais avec les meilleurs modèles propriétaires, démocratisant l’accès à l’IA de pointe et permettant aux entreprises d’héberger leurs propres modèles.

-

Computer use et agents autonomes : Les modèles de 2026 franchissent une étape majeure avec la capacité d’interagir directement avec des environnements informatiques. GPT-5.4 intègre nativement le computer use, et les modèles de raisonnement comme o3 peuvent combiner de manière agentique tous les outils disponibles (recherche web, exécution de code, analyse d’images) pour résoudre des tâches complexes de bout en bout.

-

Apprentissage par renforcement avec rétroaction humaine (RLHF) : Le RLHF reste une méthode clé pour aligner les réponses des LLM avec les attentes humaines. Il s’agit d’un processus itératif qui a considérablement progressé, notamment grâce aux techniques de reinforcement learning appliquées au raisonnement.

-

Capacités multimodales : Les LLMs récents sont de plus en plus nativement multimodaux, capables de traiter et de générer du texte, des images, de l’audio et de la vidéo. Llama 4 et Gemini 3 sont des exemples marquants de cette tendance.

Attention toutefois, on entend beaucoup parler dans les médias d’un concept : l’AGI (intelligence artificielle générale). Le débat est vif parmi les experts. Sam Altman (OpenAI), Dario Amodei (Anthropic) et Elon Musk (xAI) estiment qu’une forme d’AGI pourrait émerger dès fin 2026 ou début 2027. Demis Hassabis et Shane Legg (Google DeepMind) tablent plutôt sur 2028-2030. Les prévisions agrégées (Metaculus, marchés prédictifs, experts de l’industrie) donnent en moyenne 25 % de probabilité d’atteindre l’AGI d’ici 2029 et 50 % d’ici 2033, un calendrier qui s’est considérablement resserré par rapport aux estimations de 2020 qui plaçaient l’AGI à 50 ans. Des améliorations majeures en généralisation, en apprentissage autonome et en raisonnement abstrait restent nécessaires avant d’y parvenir. En attendant, les LLMs actuels sont déjà suffisamment puissants pour transformer en profondeur les entreprises, en s’appuyant sur le RAG et d’autres méthodes d’orchestration pour créer un avantage compétitif significatif.

Questions fréquentes

Que signifie LLM en français ?

LLM est l’acronyme anglais de Large Language Model, traduit en français par grand modèle de langage. Il désigne un modèle d’intelligence artificielle entraîné sur d’immenses corpus de texte pour comprendre et générer du langage naturel.

Est-ce que ChatGPT est un LLM ?

Non, ChatGPT n’est pas un LLM en lui-même : c’est une interface conversationnelle qui s’appuie sur les LLM développés par OpenAI (notamment GPT-5.4 et ses variantes en 2026). Le LLM est le moteur, ChatGPT est le produit grand public qui l’expose.

Quel est le LLM utilisé par ChatGPT ?

En 2026, ChatGPT s’appuie principalement sur GPT-5.4 (sorti le 5 mars 2026), avec ses déclinaisons GPT-5.4 mini et GPT-5.4 nano, ainsi que sur les modèles de raisonnement o3 et o4-mini selon le mode choisi. La sélection du modèle se fait automatiquement ou manuellement selon l’abonnement.

Quelle est la différence entre l'IA et un LLM ?

L’IA est un domaine large qui regroupe toutes les techniques permettant à une machine de simuler l’intelligence humaine (vision, robotique, planification…). Un LLM est un type particulier d’IA, spécialisé dans le traitement du langage. Tous les LLM sont des IA, mais toutes les IA ne sont pas des LLM.

Quel est le meilleur LLM en 2026 ?

Au sommet du classement Chatbot Arena début 2026, Claude Opus 4.6 (ELO 1504) d’Anthropic devance Gemini 3.1 Pro (ELO 1500) et GPT-5.4. Mais “le meilleur” dépend du cas d’usage : coût, latence, contexte, souveraineté. Pour comparer en détail, consultez le comparatif LLM 2026.

Combien coûte l'utilisation d'un LLM ?

Les prix varient de 0,14 $ par million de tokens en entrée pour DeepSeek V3.2 à 25 $ par million de tokens en sortie pour Claude Opus 4.6, soit un écart de près de 900x. Le coût réel dépend du volume, de la longueur des prompts et du nombre d’appels. Le simulateur de coûts IA permet d’estimer le budget mensuel selon votre cas d’usage.

Quels sont les principaux LLM open source en 2026 ?

Les principaux LLM open source en 2026 sont Mistral Large 3 (675B, Apache 2.0, France), Llama 4 (Meta, contexte jusqu’à 10M tokens), DeepSeek V3.2 (Chine, MIT), Qwen 3.5 (Alibaba, multimodal natif), GLM-5.1 (Zhipu AI, MIT) et Kimi K2.5 (Moonshot AI, 1T paramètres).