RAG et MCP : la combinaison qui fait entrer l’IA dans une nouvelle ère opérationnelle

18 min de lecture

Mis à jour le

L’Intelligence Artificielle a cessé d’être une simple promesse pour devenir la force motrice de la transformation numérique. Grâce aux percées spectaculaires du Machine Learning et, plus récemment, du Deep Learning avec l’avènement des Large Language Models (LLMs), les systèmes d’IA se sont profondément transformés. En 2025, le passage des assistants conversationnels aux agents opérationnels s’est concrétisé : des intelligences agissantes qui planifient, exécutent et orchestrent des tâches complexes en toute autonomie, capables de manipuler des outils et de prendre des décisions. En 2026, cette tendance s’accélère avec la maturité des protocoles standardisés, l’essor du Context Engineering comme discipline architecturale (doser précisément l’information fournie à l’agent à chaque étape de son raisonnement) et le passage du RAG d’une architecture expérimentale à une infrastructure de production critique dans les entreprises.

Cette puissance d’action nouvelle exige une double garantie : l’agent doit être à la fois fiable et agissant. Il doit s’appuyer sur des sources de vérité pour éviter les “hallucinations”, tout en étant capable de se connecter et d’interagir avec les logiciels métiers existants. Cet article décrypte la synergie entre les deux technologies fondamentales qui rendent cette transition possible : la Retrieval-Augmented Generation (RAG), qui assure la précision factuelle et augmente l’intelligence du modèle, et le Model Context Protocol (MCP), qui fournit le standard d’interopérabilité nécessaire pour que l’IA puisse passer de la simple connaissance à l’exécution concrète d’actions dans le monde réel. Préparez-vous à découvrir comment ce duo est en train de redéfinir l’avenir du logiciel.

Pilier RAG : augmenter la fiabilité et vaincre les hallucinations des LLM

La Retrieval-Augmented Generation (RAG) est le couteau suisse des développeurs qui veulent personnaliser un LLM sans passer par la case fine-tuning. Elle illustre la manière dont le deep learning repousse les limites de l’IA en combinant la recherche d’information à la génération de texte, améliorant ainsi considérablement la pertinence et la fiabilité des réponses. Le RAG apporte une nouvelle couche d’intelligence aux systèmes basés sur l’IA en s’appuyant sur une base de connaissances externe. Depuis 2024, le RAG a considérablement évolué avec l’émergence du RAG agentique, du Graph RAG et du RAG multimodal, transformant les pipelines statiques en architectures modulaires, adaptatives et capables de traiter texte, images, audio et vidéo simultanément.

Décryptage du RAG : Le mécanisme de contextualisation

La RAG représente une fusion innovante entre la récupération d’informations et la génération de contenu. Le RAG fonctionne en deux étapes :

-

Récupération (Retrieval) : Le système utilise un processus de recherche d’informations pour sélectionner des documents ou des chunks d’informations pertinents à partir d’une base de connaissances externe (souvent vectorisée).

-

Génération (Generation) : Le LLM génère ensuite une réponse en utilisant les informations récupérées comme contexte supplémentaire au prompt initial.

Cette approche est un excellent choix lorsque :

-

Le cas parfait : la base de connaissances structurée. Un assistant qui répond aux questions sur le droit du travail, la réglementation ou les conditions de vente. Les documents sont homogènes, les questions sont factuelles et le besoin est consultatif.

-

Le cas où le RAG s’impose : la documentation technique. Des centaines de pages de guides utilisateurs, mises à jour trimestriellement, où les utilisateurs posent des questions factuelles (“comment configurer X ?”). Le RAG est le choix évident car la documentation est déjà structurée et évolue à un rythme gérable.

Le RAG permet à un LLM d’accéder à des ressources de données supplémentaires sans nécessiter de réentraînement coûteux, réduisant ainsi les coûts opérationnels associés et assurant que les réponses sont basées sur des informations vérifiées et à jour.

Les évolutions du RAG : agentique, Graph RAG et multimodal

Le RAG classique (retrieve-and-read en une seule passe) a laissé place à des architectures plus sophistiquées :

-

RAG Agentique (Agentic RAG) : Au lieu d’une seule étape de récupération, un agent autonome est intégré dans le pipeline RAG. Il décide dynamiquement quel type de recherche effectuer, quels appels API lancer, et peut itérer en boucle jusqu’à obtenir la meilleure réponse. Le RAG agentique intègre des design patterns comme la réflexion, la planification, l’utilisation d’outils et la collaboration multi-agents pour adapter sa stratégie de récupération à la complexité de chaque requête. En 2026, les variantes Self-RAG (auto-évaluation de la pertinence des documents récupérés avant génération) et Corrective RAG (CRAG) (vérification et correction automatique des réponses avec relance de recherche si nécessaire) sont devenues des patterns standard qui réduisent les hallucinations de manière significative.

-

Graph RAG : Là où le RAG vectoriel classique excelle sur les questions factuelles ciblées, il peine face aux questions “globales” qui nécessitent de relier plusieurs concepts. Le Graph RAG, popularisé par Microsoft en 2024, construit un graphe entités-relations sur le corpus documentaire. Cette approche structure les données en nœuds (entités) et arêtes (relations), offrant à l’IA une “carte” plutôt qu’une simple “liste”. Des implémentations comme LightRAG combinent graphes de connaissances et recherche vectorielle pour couvrir à la fois les requêtes locales et globales. En 2026, la précision de recherche atteint jusqu’à 99 % grâce aux ontologies structurées et aux taxonomies intégrées au graphe.

-

RAG Multimodal : L’une des avancées majeures de 2026 est le RAG multimodal, capable de récupérer et raisonner simultanément sur du texte, des images, des vidéos et des données tabulaires. Alors que 80 à 90 % des données d’entreprise sont non textuelles (schémas techniques, photos de sinistres, imagerie médicale, catalogues produits), le RAG purement textuel passait à côté d’une part critique d’information. Les modèles d’embedding visuels comme la famille Qwen3-VL permettent désormais d’indexer et de rechercher dans des documents complexes mêlant graphiques, tableaux et texte.

-

RAG modulaire et hybride : Les pipelines modernes décomposent le processus en agents spécialisés : résolution d’acronymes, décomposition en sous-requêtes, extraction de mots-clés, reranking adaptatif et auto-réflexion. Cette modularité permet d’optimiser chaque étape indépendamment. L’interprétabilité est devenue un standard de production en 2026 : suivi de citations, attribution de sources et score de confiance font partie intégrante des interfaces RAG en entreprise.

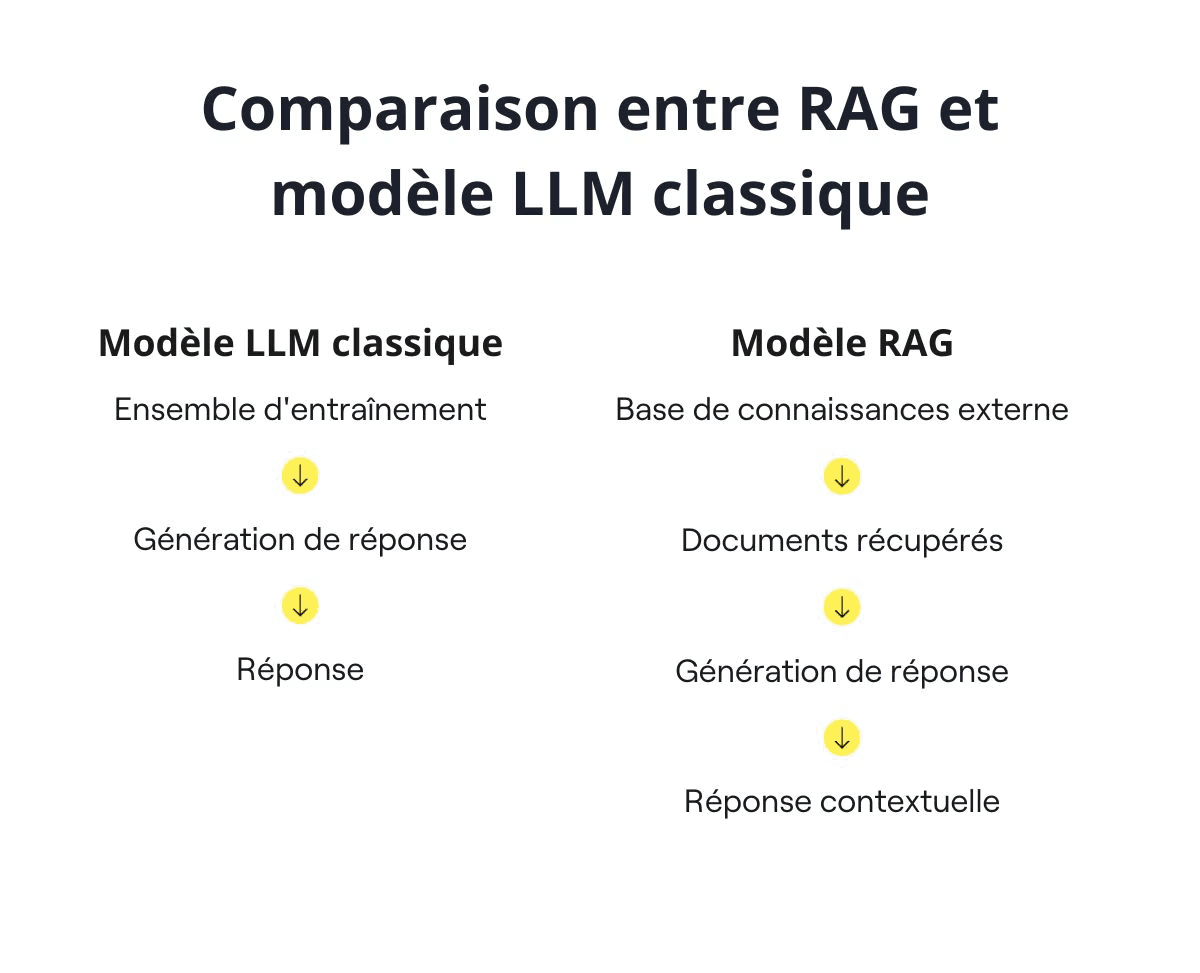

RAG vs. LLM classique : le facteur de connaissance actuelle

Un modèle LLM classique se fonde exclusivement sur les données sur lesquelles il a été formé. Sa performance est limitée, et surtout, il est vulnérable aux « hallucinations ».

| Caractéristique | LLM Classique | RAG |

|---|---|---|

| Source de Connaissance | Limité aux données sur lesquelles il a été entraîné (connaissance figée). | Accède à des informations vérifiées et actuelles via une base externe. |

| Fiabilité | Risque d’hallucinations élevé. | Réduction significative du risque d’hallucinations en s’appuyant sur des sources factuelles. |

| Coût/Mise à Jour | Nécessite un réentraînement coûteux et long pour toute mise à jour. | Mise à jour rapide de la base de connaissances. |

Limites du RAG : quand la solution devient un blocage

Le RAG n’est pas une solution miracle. Les limites apparaissent vite hors du cadre “FAQ sur base documentaire stable” :

-

Limite #1 : Le problème des actions Un RAG ne sait faire que de la consultation. Si votre agent doit créer un rendez-vous ou mettre à jour un CRM, vous devez empiler des couches de code autour du RAG pour orchestrer ces actions, transformant votre architecture en une véritable usine à gaz. C’est là que l’architecture agent devient plus pertinente.

-

Limite #2 : Le décalage du temps réel

Un RAG fonctionne sur des données pré-vectorisées. Si vous voulez accéder au solde d’un compte ou à la disponibilité d’un produit en stock, vous êtes coincé : soit vous re-vectorisez en permanence (coût prohibitif et latence inacceptable), soit vos données sont obsolètes. Ce besoin de données temps réel est une impasse classique du RAG.

-

Limite #3 : La qualité de recherche vectorielle

Si l’utilisateur demande “montrez-moi les clients mécontents”, la recherche vectorielle doit comprendre que “mécontent” = “feedback négatif” = “note NPS basse”. La recherche peut ramener des passages sémantiquement proches mais factuellement inadaptés, créant des problèmes de précision.

-

Limite #4 : Les hallucinations paradoxales persistent

Le LLM peut toujours combiner maladroitement plusieurs passages récupérés et créer des informations fausses qui semblent cohérentes. Un RAG réduit les hallucinations, mais ne les élimine pas.

Pilier MCP : Le protocole pour rendre l’IA agissante et interopérable

Pour répondre aux limites d’action du RAG et à la complexité des architectures hybrides, l’agent IA a besoin d’un standard pour interagir avec l’environnement logiciel. C’est la raison d’être du Model Context Protocol (MCP), la clé pour rendre un logiciel vraiment intelligent et piloter les apps métiers sans interface graphique. Lancé par Anthropic fin 2024, le MCP est devenu en moins de deux ans le standard de facto pour l’interopérabilité IA, avec 97 millions de téléchargements mensuels de SDK atteints en mars 2026 et plus de 9 400 serveurs MCP publics indexés dans le registre officiel en avril 2026 (croissance mensuelle d’environ +18 %). En décembre 2025, Anthropic a donné le protocole à l’Agentic AI Foundation (AAIF), un fonds sous la Linux Foundation cofondé avec Block et OpenAI, dont les membres Platinum incluent AWS, Anthropic, Block, Bloomberg, Cloudflare, Google, Microsoft et OpenAI. L’AAIF compte désormais plus de 170 membres en avril 2026 (dont Cisco, Datadog, Docker, IBM, Oracle, Salesforce, SAP, Shopify, Snowflake, Uber, Hugging Face), confirmant le statut de standard ouvert et indépendant du MCP.

MCP vs. API REST : Un nouveau paradigme d’action pour l’IA

Le MCP, c’est l’équivalent, pour les agents IA, de ce que les APIs REST ont été pour les développeurs. C’est une bascule où l’interface n’est plus destinée à des humains, mais à des intelligences artificielles.

Le MCP permet à une application d’exposer ses fonctionnalités sous forme de “tools” — des capacités décrites en langage naturel, lisibles et utilisables par les principaux modèles du marché. ChatGPT, Claude, Gemini, Microsoft Copilot, GitHub Copilot, Cursor, Replit, Zed et Visual Studio Code ont tous intégré le support MCP natif, et les plateformes de données d’entreprise commencent à proposer un support MCP intégré.

| Caractéristique | API REST | Model Context Protocol (MCP) |

|---|---|---|

| Cible | Conçue pour des humains qui codent. | Conçue pour des IA qui comprennent. |

| Description | Expose des endpoints structurés (documentation complexe). | Expose des capacités en langage naturel (“tools” auto-décrits). |

| Découvrabilité | Exige de construire manuellement les appels. | Permet la découverte dynamique : l’agent interroge, comprend et agit. |

On passe d’un monde d’API conçues pour les développeurs à un monde d’actions conçues pour les intelligences.

Fonctionnement du MCP et cas d’usage stratégiques

Techniquement, le MCP repose sur un modèle simple client-serveur. L’agent IA (client) découvre les tools disponibles, comprend leurs paramètres, et exécute les bonnes actions. L’application (serveur) exécute l’action et renvoie une réponse lisible par l’agent.

-

Résolution du Problème des Actions : Contrairement à un RAG qui ne peut que lire et synthétiser, un agent utilisant le MCP peut faire. L’assistant commercial, au lieu de s’arrêter à la consultation, peut interroger votre CRM pour l’historique (outil #1), vérifier les disponibilités (outil #2), créer le rendez-vous (outil #3) et envoyer l’invitation (outil #4).

-

Résolution des Données Temps Réel : Avec les agents + MCP, fini la galère de vectorisation permanente. L’agent interroge directement les systèmes sources quand il en a besoin. Le statut d’une commande est récupéré en temps réel depuis votre système logistique. Plus d’infrastructure de vectorisation à maintenir, plus de décalage temporel.

-

Traçabilité et Débogage : C’est un avantage précieux en production. Avec MCP, chaque appel d’outil est tracé (quel outil, quels paramètres, quelle réponse). Quand votre assistant donne une mauvaise réponse, vous voyez immédiatement si l’outil a renvoyé de mauvaises données ou si c’est le LLM qui a mal interprété. Là où le RAG reste une boîte noire, le MCP offre une traçabilité complète.

L’implémentation d’un MCP reste accessible : il suffit d’exposer proprement quelques fonctions clés — lire des données, créer un objet, déclencher une action.

MCP et A2A : deux protocoles complémentaires

En avril 2025, Google a lancé l’Agent-to-Agent Protocol (A2A) avec le soutien de plus de 50 partenaires technologiques (Atlassian, Salesforce, SAP, ServiceNow, etc.). MCP et A2A jouent des rôles complémentaires :

- MCP gère la communication verticale : comment un agent se connecte à ses outils, APIs et sources de données.

- A2A gère la communication horizontale : comment des agents intelligents collaborent entre eux pour accomplir des tâches complexes.

En pratique, un agent A2A client peut demander à un agent A2A serveur d’exécuter une tâche. L’agent serveur utilise ensuite MCP pour interagir avec les outils, APIs et sources de données nécessaires. Début 2026, A2A est passé en version 1.0 puis 1.2, qui introduit les cartes d’agent signées cryptographiquement pour la vérification de domaine, en plus du support gRPC et d’un SDK Python étendu. Le protocole, transféré à la Linux Foundation en juin 2025 et désormais gouverné par l’AAIF, est utilisé en production par plus de 150 organisations (dont Microsoft, AWS, Salesforce, SAP, ServiceNow). Google a également lancé le support A2A natif dans son Agent Development Kit (ADK) et la plateforme Agentspace. Cette complémentarité dessine l’architecture des systèmes multi-agents d’entreprise en 2026.

Roadmap MCP 2026 : vers un protocole stateless et découvrable

La feuille de route MCP 2026, organisée autour de groupes de travail thématiques, cible quatre priorités majeures avec une prochaine version de la spécification prévue pour juin 2026 :

-

Scalabilité du transport : Le transport Streamable HTTP permet aux serveurs MCP de fonctionner comme des services distants, mais le passage à l’échelle révèle des frictions (sessions stateful incompatibles avec les load balancers, scaling horizontal complexe). L’objectif est de rendre le protocole stateless tout en supportant les sessions applicatives, avec un mécanisme proche des cookies pour découpler l’état de la couche transport.

-

Découverte de serveurs (Server Cards) : Les MCP Server Cards permettent d’exposer les métadonnées d’un serveur via une URL

.well-known/mcp/server-card.json, rendant les serveurs découvrables par les crawlers, registres et clients sans connexion préalable. Un registre officiel MCP, soutenu par Anthropic, GitHub et Microsoft, indexe automatiquement les serveurs qui publient leur descripteur. -

Maturité entreprise : Les besoins d’audit, SSO, passerelles et portabilité de configuration sont traités via des extensions plutôt que des modifications du protocole de base, pour garder la spécification légère. La première extension officielle, MCP Apps (SEP-1865), a été publiée le 26 janvier 2026 par Anthropic, OpenAI et la communauté MCP-UI : elle standardise la livraison d’interfaces interactives (dashboards, formulaires, visualisations) depuis un serveur MCP vers des hosts comme Claude ou ChatGPT, avec sandboxing iframe obligatoire.

-

Opérations asynchrones : Le groupe de travail Agents ajoute le support des tâches de longue durée, permettant aux serveurs de lancer une opération et aux clients de récupérer le résultat ultérieurement.

Déploiement et synergie RAG-MCP : l’avenir de l’agent autonome

L’agent IA mature ne choisit pas entre RAG et MCP ; il utilise les deux. Le RAG assure la connaissance factuelle et la fiabilité, tandis que le MCP garantit l’action et l’interopérabilité. Ensemble, ils forment les fondations de l’agent augmenté.

Architecture hybride : quand faut-il combiner RAG, MCP et fine-tuning ?

La réalité des SaaS IA matures est qu’ils combinent plusieurs approches via un système de routing intelligent :

-

Requêtes factuelles simples → RAG sur la base de connaissances pour la traçabilité des sources.

-

Tâches répétitives spécialisées → Modèle fine-tuné pour la rapidité et la haute précision (ex. : classification d’emails clients dans 15 catégories métier).

-

Actions multi-systèmes ou données temps réel → Agents avec MCP.

-

Génération créative ou prototypage rapide → Prompt engineering avancé.

Cette sophistication technique se justifie quand votre SaaS atteint une certaine maturité et que l’optimisation des coûts devient critique.

Les coûts : sous-estimer la maintenance et le débogage

Beaucoup voient le RAG comme une solution économique car il évite le fine-tuning. C’est vrai, mais la réalité des coûts de maintenance est souvent sous-estimée :

-

Coûts RAG : Le setup initial reste modéré, mais chaque mise à jour significative des données nécessite de re-vectoriser, de vérifier la qualité du retrieval et d’ajuster les paramètres. La maintenance continue mobilise plusieurs heures d’ingénierie par mois. Le débogage reste difficile à cause de l’opacité partielle du RAG.

-

Coûts fine-tuning : Le setup est sensiblement plus élevé, avec des coûts récurrents d’hébergement et de réentraînement. En revanche, pour les applications à fort volume de tokens, le fine-tuning peut devenir plus rentable sur le long terme grâce à des réponses plus rapides et moins de tokens consommés par requête.

-

Coûts MCP : L’infrastructure de vectorisation disparaît (donc moins de frais fixes), mais les coûts d’appels API (LLM + systèmes métiers) peuvent augmenter significativement par rapport à un RAG basique, car l’agent fait plusieurs appels atomiques pour composer sa réponse.

-

Tendance : l’approche hybride. Le pattern le plus efficace combine le fine-tuning pour le style et le suivi d’instructions spécifiques à l’organisation, le RAG pour accéder à la base de connaissances dynamique et propriétaire, et le MCP pour l’exécution d’actions en temps réel.

La décision technique est avant tout une décision business basée sur le budget, le volume de requêtes, la fréquence de mise à jour des données et les besoins d’action.

Sécurité et éthique : les précautions cruciales

L’intégration de systèmes RAG et MCP pose des défis qui demandent rigueur. La spécification MCP a considérablement renforcé son volet sécurité en 2025 :

-

Authentification MCP — les avancées de la spec 2025 : La spécification MCP de novembre 2025 a rendu OAuth 2.1 avec PKCE (Proof Key for Code Exchange) obligatoire. Les serveurs MCP sont désormais classifiés comme des OAuth Resource Servers, et les clients doivent implémenter les Resource Indicators (RFC 8707) pour garantir que chaque token d’accès est strictement limité au serveur visé. Malgré ces avancées, une étude de 2025 révèle que 53 % des serveurs MCP reposent encore sur des secrets statiques (clés API, tokens personnels), tandis que l’adoption d’OAuth reste à 8,5 %. Le TypeScript SDK, en v1.29.0 en mai 2026 (la branche v1.x reste recommandée en production, la v2 stable est encore en préparation), a corrigé plusieurs vulnérabilités critiques début 2026 : une faille ReDoS (CVE-2026-0621) permettant de bloquer un serveur via un URI malformé, et une fuite de données multi-tenant (CVE-2026-25536) où des connexions concurrentes pouvaient recevoir les données d’un autre client. La surface d’attaque du SDK lui-même est désormais un sujet de vigilance à part entière.

-

Gestion d’identité en entreprise (CIMD et XAA) : La spec de novembre 2025 introduit les Client ID Metadata Documents (CIMD), qui simplifient l’enregistrement des clients MCP via une URL qu’ils contrôlent. L’extension Enterprise-Managed Authorization (XAA) permet aux administrateurs IT de créer des politiques centralisées qui pré-autorisent des agents IA de confiance à accéder à des outils métiers spécifiques, éliminant la redirection OAuth individuelle. La feuille de route 2026 prévoit un renforcement supplémentaire de la sécurité et de l’autorisation, notamment pour les agents basés navigateur.

-

Défis Techniques du RAG : Le déploiement d’un RAG performant exige l’utilisation de techniques d’apprentissage automatique pour l’indexation, le reranking adaptatif et l’optimisation du processus de récupération. Avec le Graph RAG, s’ajoute la construction et la maintenance du graphe de connaissances.

-

Risque RSE : L’aspect gourmand en ressources des modèles doit être analysé pour que les gains d’efficacité justifient l’impact environnemental. Le principe du Minimum Viable Context (MVC), issu du Context Engineering, aide à réduire l’empreinte en limitant l’information transmise au strict nécessaire à chaque étape.

Conclusion : saisir l’opportunité de l’interopérabilité 2.0

Le RAG et le MCP sont le langage commun entre les logiciels et les intelligences artificielles. Ils permettent de surmonter la limitation de la connaissance figée (RAG) et la barrière de l’interface graphique (MCP). Avec la donation du MCP à l’Agentic AI Foundation (plus de 170 membres en avril 2026), l’adoption universelle par les grands fournisseurs d’IA, le passage du protocole A2A en version 1.2 pour la collaboration inter-agents et une nouvelle version de la spécification MCP prévue pour juin 2026, l’écosystème a atteint une maturité qui rend ces architectures accessibles à toute organisation.

Les éditeurs SaaS qui adoptent le RAG agentique et multimodal pour la fiabilité, le MCP pour l’action et le Graph RAG pour le raisonnement complexe s’assurent que leur produit sera compatible avec l’ère des agents. Le bon réflexe reste de distinguer ce qui relève d’un RAG classique, d’un RAG multimodal, d’un Graph RAG, d’un fine-tuning ciblé ou d’une architecture agent avec MCP avant d’investir six mois de développement. En savoir plus sur l’intégration IA pour éditeurs logiciels.